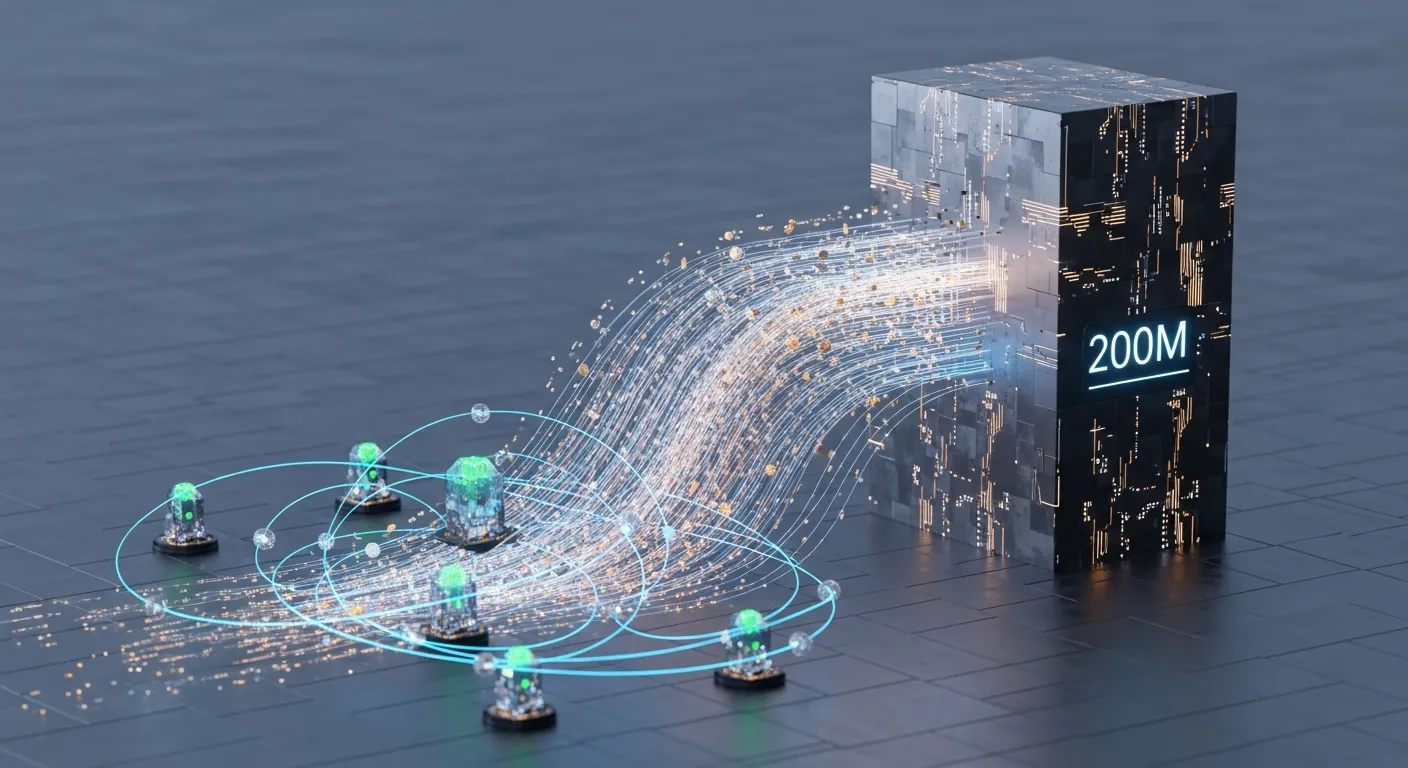

Optimiser vos Coûts IA : Guide Ultime pour l’Utilisation Économique de 200 Millions de Tokens

La discussion sur Reddit « 200 Million tokens » soulève un point crucial pour de nombreux développeurs et entreprises : l’accès abordable à des modèles d’IA performants. L’offre de 200 millions de tokens pour 18$, compatible avec les API OpenAI, Anthropic et Gemini, présente une opportunité financière intéressante, mais soulève aussi des questions stratégiques sur l’intégration et l’optimisation des coûts à long terme. Cet article propose une approche pragmatique pour maximiser le retour sur investissement de tels volumes, tout en assurant la sérénité de vos opérations.

💻 Pack Master Dev

Automatise ton code et tes tests avec les meilleurs outils IA.

Stratégie d’Intégration API pour une Flexibilité Maximale

L’avantage principal de cette offre réside dans sa compatibilité avec les API standard. Cela ouvre la porte à une intégration aisée avec divers outils et frameworks. La clé est de construire une couche d’abstraction pour pouvoir basculer entre les fournisseurs (OpenAI, Anthropic, Gemini) sans réécrire l’intégralité de votre code.

Architecture suggérée :

Mettez en place un service d’orchestration d’IA. Ce service recevra les requêtes, déterminera le modèle le plus approprié en fonction du coût et de la performance requise (ex: GPT-4 pour la génération créative complexe, Claude Haiku pour des résumés rapides), et appellera l’API correspondante.

Exemple Python avec une abstraction basique :

import openai

import anthropic

import google.generativeai as genai

# Configuration (vos API keys et points d'accès)

openai.api_key = "YOUR_OPENAI_API_KEY"

anthropic.api_key = "YOUR_ANTHROPIC_API_KEY"

genai.configure(api_key="YOUR_GEMINI_API_KEY")

def query_llm(model_provider: str, model_name: str, prompt: str) -> str:

if model_provider == "openai":

response = openai.Completion.create(model=model_name, prompt=prompt)

return response.choices[0].text

elif model_provider == "anthropic":

client = anthropic.Anthropic(api_key=anthropic.api_key)

response = client.messages.create(model=model_name, max_tokens=1000, messages=[{"role": "user", "content": prompt}])

return response.content[0].text

elif model_provider == "gemini":

model = genai.GenerativeModel(model_name)

response = model.generate_content(prompt)

return response.text

else:

raise ValueError("Fournisseur de modèle non supporté")

# Utilisation

# response = query_llm("openai", "gpt-5.4", "Écris une description de produit.")

# response = query_llm("anthropic", "claude-opus-4.6", "Résume ce texte : ...")

Optimisation des Coûts : Stratégies pour 200 Millions de Tokens

Acquérir un tel volume est une chose, le dépenser judicieusement en est une autre. Le prix par token varie considérablement entre les modèles. Une stratégie « ROI et Sérénité » implique une segmentation fine de vos usages.

Méthodes d’optimisation :

- Modèles « Légers » pour Tâches Simples : Utilisez les modèles les moins coûteux (ex: Claude Haiku, Gemini Pro) pour des tâches répétitives et moins exigeantes en compréhension fine : classification, résumé simple, extraction d’entités basique.

- Modèles « Lourds » pour Tâches Complexes : Réservez les modèles les plus performants et coûteux (ex: GPT-5.4, Claude Opus) aux tâches nécessitant une compréhension profonde, une créativité accrue ou une analyse complexe.

- Mise en Cache des Réponses : Pour les requêtes identiques ou très similaires, implémentez une logique de mise en cache pour éviter de consommer des tokens inutilement.

- Prompt Engineering Efficace : Des prompts bien conçus réduisent le nombre de tours de conversation et la quantité de texte à traiter, diminuant ainsi la consommation de tokens.

Considérations sur la Souveraineté et la Sécurité

Bien que l’offre soit attrayante, le paiement en crypto et l’utilisation d’API tierces soulèvent des questions de souveraineté des données. Pour des applications critiques ou sensibles, privilégiez des solutions auto-hébergées ou des fournisseurs européens.

Options souveraines à explorer (si le volume et la criticité le justifient) :

- Hébergement local : Déployez des modèles open-source (ex: Llama 3, Mistral) sur votre propre infrastructure, idéalement en France ou en Allemagne. Cela garantit un contrôle total sur les données.

- Fournisseurs Européens : Explorez les offres de cloud souverain proposant des solutions IA gérées.

L’avis du Labo : Cette offre représente une opportunité tactique pour tester et développer rapidement des applications IA sans un investissement initial massif. Cependant, la dépendance vis-à-vis de fournisseurs externes et le paiement en crypto sont des points de vigilance stratégique. Pour un usage pérenne et une indépendance accrue, la mise en place d’une stratégie hybride, combinant l’agilité des API publiques pour des cas d’usage non critiques et le déploiement de modèles souverains pour les données sensibles, est la voie la plus sage. La clé est une gouvernance claire de vos appels API et une veille technologique constante sur les alternatives open-source et européennes.

Conclusion : Accélération et Maîtrise des Coûts IA

L’offre de 200 millions de tokens est une porte d’entrée vers l’exploration du potentiel des LLMs. En adoptant une architecture flexible, en implémentant des stratégies d’optimisation des coûts rigoureuses et en gardant à l’esprit les impératifs de souveraineté, vous pouvez transformer cette opportunité en un levier de croissance maîtrisé. L’action immédiate consiste à segmenter vos cas d’usage et à concevoir votre couche d’abstraction API.